华硕H100GPU现货

H100GPU是英伟达推出的一款高性能图形处理器,专为满足当今数据密集型计算任务的需求而设计。它采用了的架构,具备超高的计算能力和能效比,能够提升各种计算任务的效率和速度。无论是在人工智能、科学计算还是大数据分析领域,H100GPU都能提供的性能和可靠性。其强大的并行处理能力和高带宽内存确保了复杂任务的顺利进行,是各类高性能计算应用的。H100GPU拥有先进的散热设计,确保其在长时间高负荷运行时依然能够保持稳定和高效。对于需要长时间运行的大规模计算任务来说,H100GPU的可靠性和稳定性尤为重要。它的设计不仅考虑了性能,还兼顾了散热和能效,使其在保持高性能的同时,依然能够节省能源成本。无论是企业级应用还是科学研究,H100GPU都能够为用户提供持续的高性能支持。在人工智能应用中,H100GPU的强大计算能力尤为突出。它能够快速处理大量复杂的模型训练和推理任务,大幅缩短开发时间。H100GPU的并行计算能力和高带宽内存使其能够处理更大规模的数据集和更复杂的模型结构,提升了AI模型的训练效率和准确性。此外,H100GPU的高能效比和稳定性也为企业和研究机构节省了运营成本,是人工智能开发的理想选择。H100 GPU 限时特惠,立刻抢购。华硕H100GPU现货

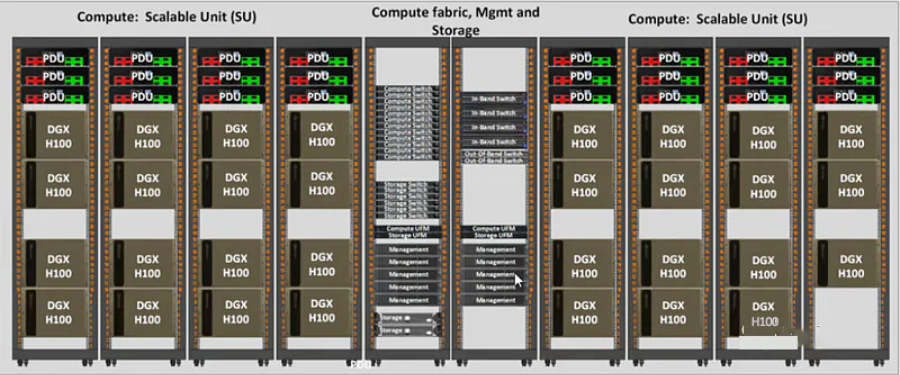

用于训练、推理和分析。配置了Bluefield-3,NDRInfiniBand和第二代MIG技术单个DGXH100系统提供了16petaFLOPS(千万亿次浮点运算)(FP16稀疏AI计算性能)。通过将多个DGXH100系统连接组成集群(称为DGXPODs或DGXSuperPODs),可以很容易地扩大这种性能。DGXSuperPOD从32个DGXH100系统开始,被称为"可扩展单元"集成了256个H100GPU,这些GPU通过基于第三代NVSwitch技术的新的二级NVLink交换机连接,提供了1exaFLOP的FP8稀疏AI计算性能。同时支持无线带宽(InifiniBand,IB)和NVLINKSwitch网络选项。HGXH100通过NVLink和NVSwitch提供的高速互连,HGXH100将多个H100结合起来,使其能创建世界上强大的可扩展服务器。HGXH100可作为服务器构建模块,以集成底板的形式在4个或8个H100GPU配置中使用。H100CNXConvergedAcceleratorNVIDIAH100CNX将NVIDIAH100GPU的强大功能与NVIDIA®ConnectX-7SmartNIC的**组网能力相结合,可提供高达400Gb/s的带宽包括NVIDIAASAP2(加速交换和分组处理)等创新功能,以及用于TLS/IPsec/MACsec加密/的在线硬件加速。这种独特的架构为GPU驱动的I/O密集型工作负载提供了前所未有的性能,如在企业数据中心进行分布式AI训练,或在边缘进行5G信号处理等。套装H100GPU货期H100 GPU 提供高精度计算支持。

使用TSMC4nm工艺定制800亿个晶体管,814mm²芯片面积。NVIDIAGraceHopperSuperchipCPU+GPU架构NVIDIAGraceCPU:利用ARM架构的灵活性,创建了从底层设计的CPU和服务器架构,用于加速计算。H100:通过NVIDIA的超高速片间互连与Grace配对,能提供900GB/s的带宽,比PCIeGen5快了7倍目录H100GPU主要特征基于H100的系统和板卡H100张量架构FP8数据格式用于加速动态规划(“DynamicProgramming”)的DPX指令L1数据cache和共享内存结合H100GPU层次结构和异步性改进线程块集群(ThreadBlockClusters)分布式共享内存(DSMEM)异步执行H100HBM和L2cache内存架构H100HBM3和HBM2eDRAM子系统H100L2cache内存子系统RAS特征第二代安全MIGTransformer引擎第四代NVLink和NVLink网络第三代NVSwitch新的NVLink交换系统PCIeGen5安全性增强和保密计算H100video/IO特征H100GPU主要特征新的流式多处理器(StreamingMultiprocessor,SM)第四代张量:片间通信速率提高了6倍(包括单个SM加速、额外的SM数量、更高的时钟);在等效数据类型上提供了2倍的矩阵乘加。MatrixMultiply-Accumulate,MMA)计算速率,相比于之前的16位浮点运算,使用新的FP8数据类型使速率提高了4倍。

大多数GPU用于什么用途?#对于使用私有云(CoreWeave、Lambda)的公司,或拥有数百或数千台H100的公司,几乎都是LLM和一些扩散模型工作。其中一些是对现有模型的微调,但大多数是您可能还不知道的从头开始构建新模型的新创业公司。他们正在签订为期3年、价值1000万至5000万美元的合同,使用几百到几千台GPU。对于使用带有少量GPU的按需H100的公司来说,其LLM相关使用率可能仍>50%。私有云现在开始受到企业的青睐,这些企业通常会选择默认的大型云提供商,但现在大家都退出了。大型人工智能实验室在推理还是训练方面受到更多限制?#取决于他们有多少产品吸引力!SamAltman表示,如果必须选择,OpenAI宁愿拥有更多的推理能力,但OpenAI在这两方面仍然受到限制。H100 GPU 降价热卖,不要错过。

H100中新的第四代TensorCore架构提供了每SM的原始稠密和稀疏矩阵数学吞吐量的两倍支持FP8、FP16、BF16、TF32、FP64、INT8等MMA数据类型。新的TensorCores还具有更**的数据管理,节省了高达30%的操作数交付能力。FP8数据格式与FP16相比,FP8的数据存储需求减半,吞吐量提高一倍。新的TransformerEngine(在下面的章节中进行阐述)同时使用FP8和FP16两种精度,以减少内存占用和提高性能,同时对大型语言和其他模型仍然保持精度。用于加速动态规划(“DynamicProgramming”)的DPX指令新引入的DPX指令为许多DP算法的内循环提供了高等融合操作数的支持,使得动态规划算法的性能相比于AmpereGPU高提升了7倍。L1数据cache和共享内存结合将L1数据cache和共享内存功能合并到单个内存块中简化了编程,减少了达到峰值或接近峰值应用性能所需的调优;为这两种类型的内存访问提供了佳的综合性能。H100GPU层次结构和异步性改进关键数据局部性:将程序数据尽可能的靠近执行单元异步执行:寻找的任务与内存传输和其他事物重叠。目标是使GPU中的所有单元都能得到充分利用。线程块集群(ThreadBlockClusters)提出背景:线程块包含多个线程并发运行在单个SM上。H100 GPU 的高性能计算能力为此类任务提供了极大支持。russiaH100GPU优惠

H100 GPU 在游戏开发中提升视觉效果。华硕H100GPU现货

H100 GPU 在边缘计算中的应用也非常。其高性能计算能力和低功耗设计使其非常适合用于边缘计算。H100 GPU 的强大并行处理能力可以高效处理实时数据,提升应用的响应速度和可靠性。无论是在智能制造、智慧城市还是物联网应用中,H100 GPU 都能提升数据处理效率,满足边缘计算的需求。其紧凑设计和高能效比为边缘计算设备提供了理想的硬件支持,是边缘计算领域的重要组成部分。

ITMALL.sale 是一家专业的 H100 GPU 代理商,以其的服务和高质量的产品赢得了广大客户的信赖。作为 NVIDIA 官方授权的代理商,ITMALL.sale 提供全系列的 H100 GPU 产品,确保客户能够获得、的图形处理器。无论是企业级应用还是个人用户,ITMALL.sale 都能够提供个性化的解决方案,满足不同客户的需求。ITMALL.sale 不仅提供产品销售,还为客户提供的技术支持和售后服务,确保客户在使用 H100 GPU 过程中无后顾之忧。 华硕H100GPU现货

上一篇: America戴尔H100GPU