深圳H100GPU how much

在游戏开发领域,H100 GPU 提供了强大的图形处理能力和计算性能。它能够实现复杂和逼真的游戏画面,提高游戏的视觉效果和玩家体验。H100 GPU 的并行处理单元可以高效处理大量图形和物理运算,减少延迟和卡顿现象。对于开发者来说,H100 GPU 的稳定性和高能效为长时间的开发和测试提供了可靠保障,助力开发者创造出更具创意和吸引力的游戏作品,是游戏开发的理想选择。其高带宽内存确保了复杂任务的顺利进行。H100 GPU 的强大图形处理能力不仅提升了游戏的视觉效果,还使得游戏运行更加流畅,玩家体验更加出色,推动了游戏开发技术的不断进步。H100 GPU 适用于人工智能训练任务。深圳H100GPU how much

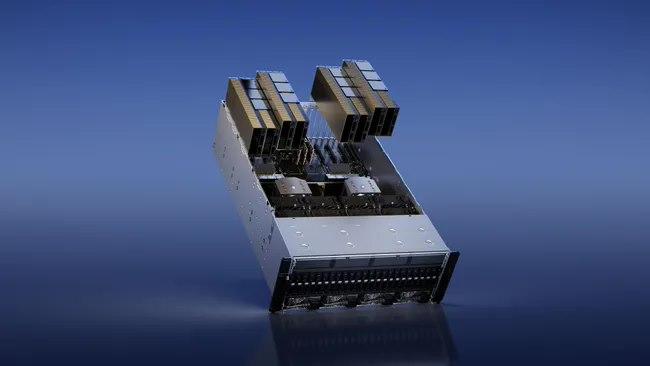

–私有云执行官什么时候会有H100继任者?#可能要到2024年底(2024年中期到2025年初)才会公布,基于Nvidia架构之间的历史时间。在此之前,H100将成为NvidiaGPU的前列产品。(GH200和DGXGH200不算在内,它们不是纯GPU,它们都使用H100作为他们的GPU)会有更高的显存H100吗?#也许是液冷120GBH100s。短缺何时结束?#与我交谈过的一个团体提到,它们实际上在2023年底之前已售罄。采购H100#谁卖H100?#戴尔,HPE,联想,Supermicro和Quanta等OEM销售H100和HGXH100。30当你需要InfiniBand时,你需要直接与Nvidia的Mellanox交谈。31因此,像CoreWeave和Lambda这样的GPU云从OEM购买,然后租给初创公司。超大规模企业(Azure,GCP,AWS,Oracle)更直接地与Nvidia合作,但他们通常也与OEM合作。即使对于DGX,您仍然会通过OEM购买。您可以与英伟达交谈,但您将通过OEM购买。您不会直接向Nvidia下订单。交货时间如何?#8-GPUHGX服务器上的提前期很糟糕,而4-GPUHGX服务器上的提前期很好。每个人都想要8-GPU服务器!如果一家初创公司***下订单,他们什么时候可以访问SSH?#这将是一个交错的部署。假设这是一个5,000GPU的订单。他们可能会在2-000个月内获得4,000或4,5个。QatarH100GPU一台多少钱H100 GPU 的基础时钟频率为 1410 MHz。

H100 GPU 的价格动态反映了市场对高性能计算设备的强烈需求。近年来,随着人工智能、深度学习和大数据分析等领域的快速发展,H100 GPU 的市场需求量大幅增加,导致其价格持续攀升。此外,全球芯片短缺和供应链问题进一步加剧了 H100 GPU 价格的波动。尽管如此,随着技术的进步和供应链的优化,H100 GPU 的生产成本有望逐步降低,从而带动市场价格的回落。然而,在短期内,H100 GPU 的价格仍将保持在一个较高的水平。H100 GPU 的市场价格受多种因素影响,近期价格波动明显。由于 H100 GPU 拥有的计算性能和广泛的应用前景,市场需求旺盛,推动了价格的上涨。此外,全球供应链紧张和半导体短缺也对 H100 GPU 的价格造成了影响,导致其市场价格居高不下。然而,随着市场逐渐稳定和供应链的改善,预计 H100 GPU 的价格将逐步趋于合理。对于企业和研究机构而言,了解 H100 GPU 的价格动态有助于制定更加合理的采购策略,以获取比较好的性价比。

H100 GPU 采用了 NVIDIA 的架构技术,其架构采用 Ampere 架构,使其在性能和能效方面都达到了一个新的高度。H100 GPU 具有 8192 个 CUDA ,能够提供极高的并行处理能力,对于需要大量计算资源的任务,如深度学习训练和科学计算,H100 GPU 能够提升效率。其基础时钟频率为 1410 MHz,增强时钟频率可达 1665 MHz,确保在高负载下依然能够提供稳定的性能输出,其 Tensor Core 性能可达 312 TFLOPS,特别适合深度学习和神经网络训练等需要大量矩阵运算的任务,极大地提升了计算效率。H100 GPU 提供高效的功耗管理。

我理解的就是这些等待的线程在等待的时候无法执行其他工作)也是一个分裂的屏障,但不对到达的线程计数,同时也对事务进行计数。为写入共享内存引入一个新的命令,同时传递要写入的数据和事务计数。事务计数本质上是对字节计数异步事务屏障会在W**t命令处阻塞线程,直到所有生产者线程都执行了一个Arrive,所有事务计数之和达到期望值。异步事务屏障是异步内存拷贝或数据交换的一种强有力的新原语。集群可以进行线程块到线程块通信,进行隐含同步的数据交换,集群能力建立在异步事务屏障之上。H100HBM和L2cache内存架构HBM存储器由内存堆栈组成,位于与GPU相同的物理封装上,与传统的GDDR5/6内存相比,提供了可观的功耗和面积节省,允许更多的GPU被安装在系统中。devicememory:驻留在HBM内存空间的CUDA程序访问的全局和局部内存区域constantcache:驻留在devicememory内的不变内存空间texturecache:驻留在devicememory内的纹理和表面内存空间L2cache:对HBM内存进行读和写servicesmemory请求来源于GPU内的各种子系统HBM和L2内存空间对所有SM和所有运行在GPU上的应用程序都是可访问的。HBM3或HBM2eDRAM和L2缓存子系统都支持数据压缩和解压缩技术。H100 GPU 在云计算中的应用也非常多。xfusionH100GPU优惠

H100 GPU 的带宽高达 1.6 TB/s。深圳H100GPU how much

因此线程可以自由地执行其他**的工作。②终线程需要其他所有线程产生的数据。在这一点上,他们做一个"等待",直到每个线程都有"抵达"的信号。-***是允许提前到达的线程在等待时执行**的工作。-等待的线程会在共享内存中的屏障对象上自转(spin)(我理解的就是这些等待的线程在等待的时候无法执行其他工作)也是一个分裂的屏障,但不对到达的线程计数,同时也对事务进行计数。为写入共享内存引入一个新的命令,同时传递要写入的数据和事务计数。事务计数本质上是对字节计数异步事务屏障会在W**t命令处阻塞线程,直到所有生产者线程都执行了一个Arrive,所有事务计数之和达到期望值。异步事务屏障是异步内存拷贝或数据交换的一种强有力的新原语。集群可以进行线程块到线程块通信,进行隐含同步的数据交换,集群能力建立在异步事务屏障之上。H100HBM和L2cache内存架构HBM存储器由内存堆栈组成,位于与GPU相同的物理封装上,与传统的GDDR5/6内存相比,提供了可观的功耗和面积节省,允许更多的GPU被安装在系统中。深圳H100GPU how much